👋 Ich absolviere derzeit einen Master in Informatik an der Northeastern University. Meine Forschungsschwerpunkte liegen in NLP, Information Retrieval, Retrieval-Augmented Generation, Empfehlungssystemen und Multi-Agenten-Systemen. Mein Google-Scholar-Profil finden Sie hier

🎓 Meinen B.Sc. in Informatik habe ich an der Harbin Engineering University erworben. Aktuell forsche ich im Rahmen meines Masterstudiums am NEUIR Lab, betreut von Associate Professor Zhenghao Liu. Außerdem arbeite ich eng mit Qiyuan Lab  , ModelBest

, ModelBest

zusammen und werde zusätzlich von Associate Researcher Yukun Yan betreut.

zusammen und werde zusätzlich von Associate Researcher Yukun Yan betreut.

🔥 Wir laden Sie herzlich ein, unser neues Projekt UltraRAG v3 auszuprobieren und mitzugestalten!

🔥 Feedback, Ideen und Beiträge sind jederzeit willkommen.

🔥 Neuigkeiten

- 2026.02: 🎉 Unser Paper Knowledge Intensive Agents wurde bei AI Open (IF=14.8) angenommen!

- 2026.01: 🎉 UltraRAG v3

erreichte Platz 2 bei GitHub Trending!

- 2026.01: 🎉 Wir haben UltraRAG v3 veröffentlicht, sodass jeder Schritt der Inferenz transparent nachvollziehbar wird!

- 2025.11: 🎉 Unser Paper LISRec wurde bei KDD 2026 (CCF-A) angenommen!

- 2025.11: 🎉 Wir haben UltraRAG v2.1 veröffentlicht und multimodale Unterstützung sowie ein einheitlicheres Evaluations-Framework ergänzt!

- 2025.08: 🎉 Wir haben UltraRAG v2 veröffentlicht, ein Low-Code-Framework zum Aufbau komplexer RAG-Systeme!

- 2025.08: 🎉 Unser Paper TASTE$^+$ wurde bei WISA 2025 angenommen und für eine mündliche Präsentation ausgewählt!

- 2025.08: 🎉 Unser Paper LLMsPark wurde bei EMNLP 2025 (CCF-B) angenommen!

- 2024.04: 🎉 Wir haben das GitHub-Repository heu-icicles

veröffentlicht und laden herzlich zum Mitwirken ein!

- 2024.02: 🎉 Unser Paper MMAD wurde bei COLING 2024 (CCF-B) angenommen!

- 2023.05: 🎉 Unser Paper erhielt eine Honorable Mention beim MCM/ICM 2023!

📝 Publikationen

* kennzeichnet gleichen Beitrag, und † kennzeichnet den korrespondierenden Autor.

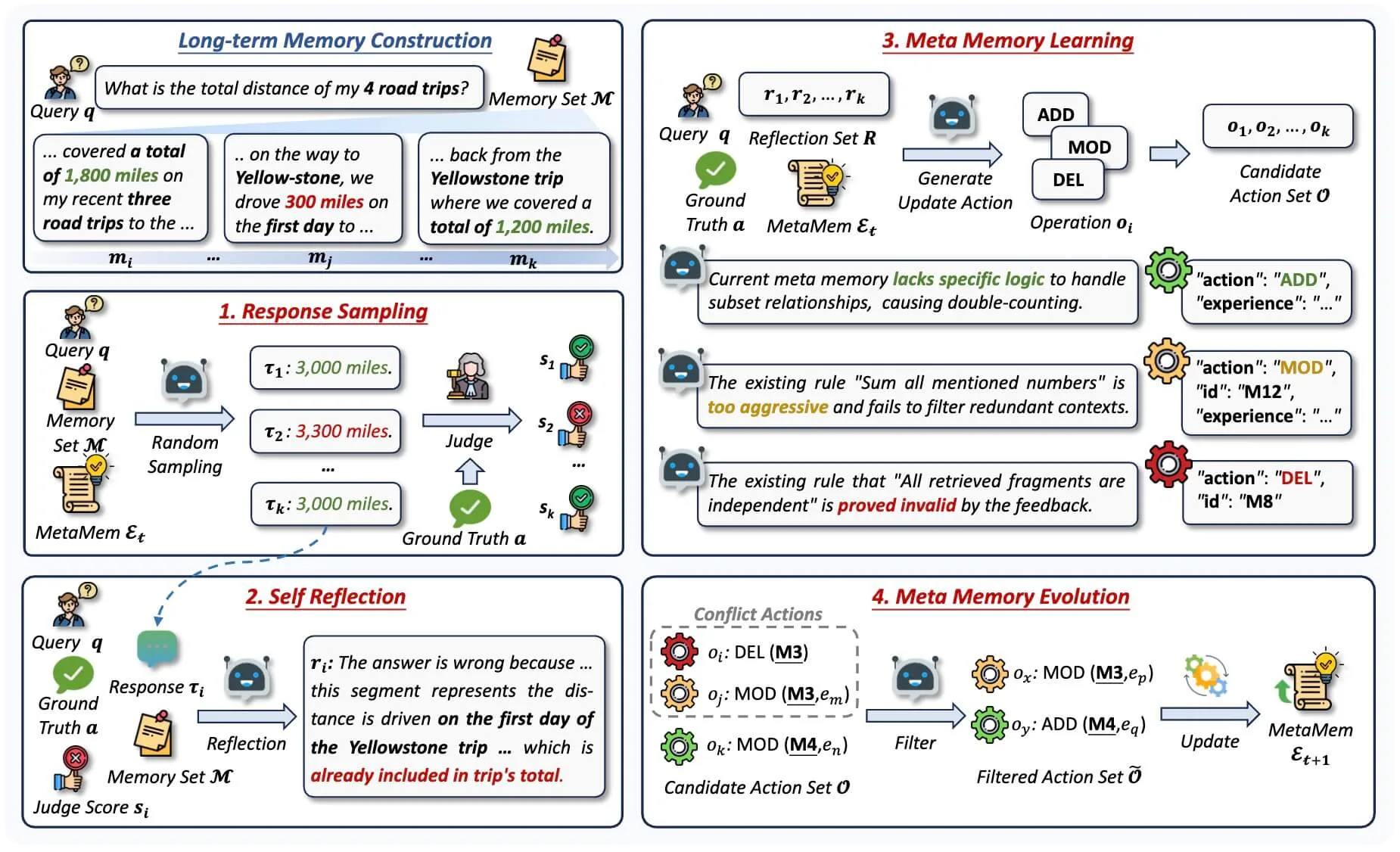

MetaMem: Evolving Meta-Memory for Knowledge Utilization through Self-Reflective Symbolic Optimization

Haidong Xin$^{*}$, Xinze Li$^{*}$, Zhenghao Liu$^†$, Yukun Yan$^†$, Shuo Wang, Cheng Yang, Yu Gu, Ge Yu, Maosong Sun

Diese Arbeit stellt MetaMem vor, ein Meta-Memory-Framework, das Meta-Gedächtnis durch selbstreflektierende symbolische Optimierung weiterentwickelt und so die Wissensnutzung in langfristigen Mensch-LLM-Interaktionen verbessert.

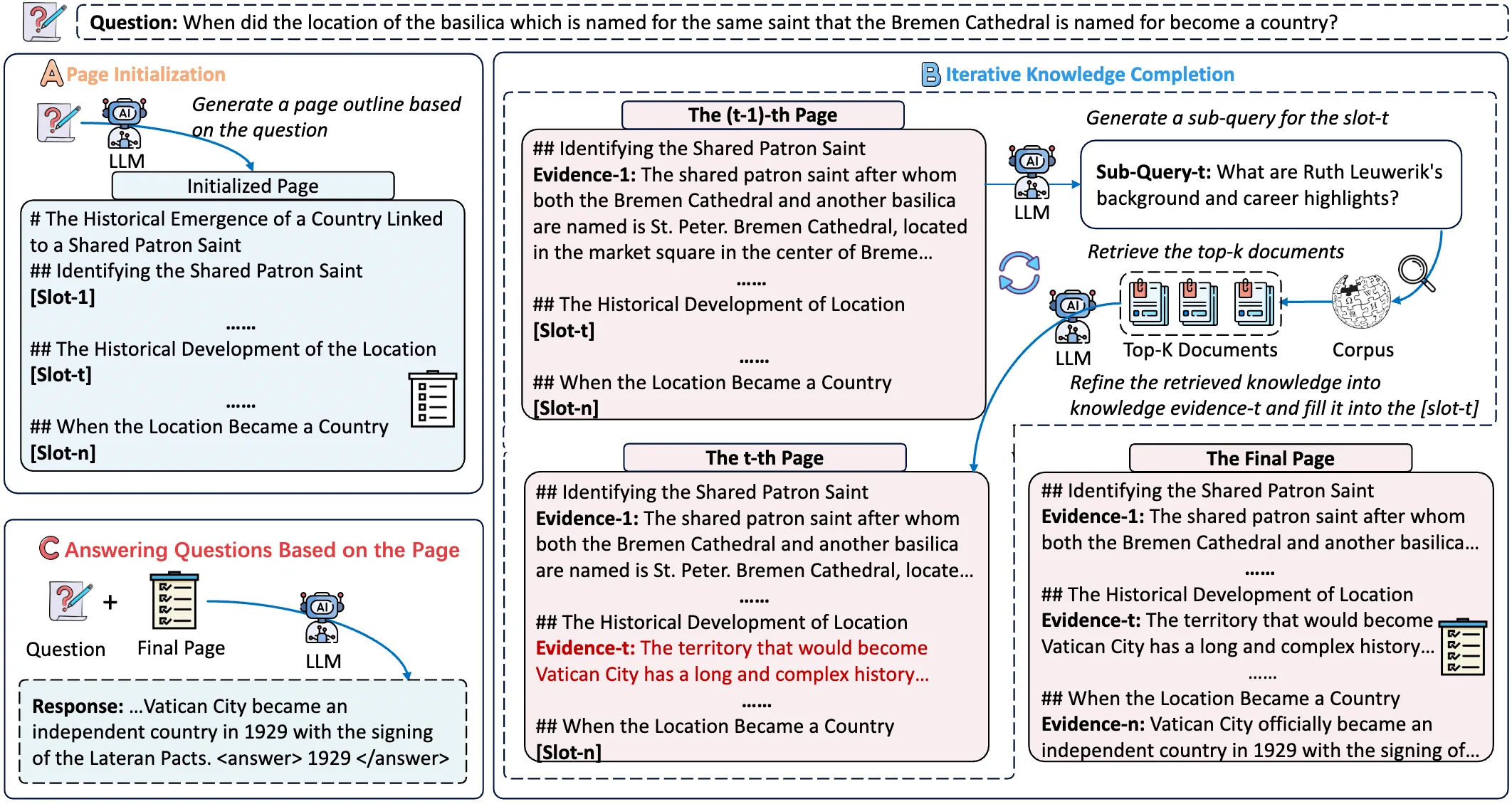

Structured Knowledge Representation through Contextual Pages for Retrieval-Augmented Generation

Xinze Li, Zhenghao Liu$^†$, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Zheni Zeng, Sen Mei, Ge Yu, Maosong Sun

Diese Arbeit verbessert RAG-Systeme, indem strukturierte kognitive Gliederungen aufgebaut werden, die die iterative Suche steuern und mehrdimensionale Wissensbestände in kohärente Seiten organisieren, um präzisere Antworten zu erzeugen.

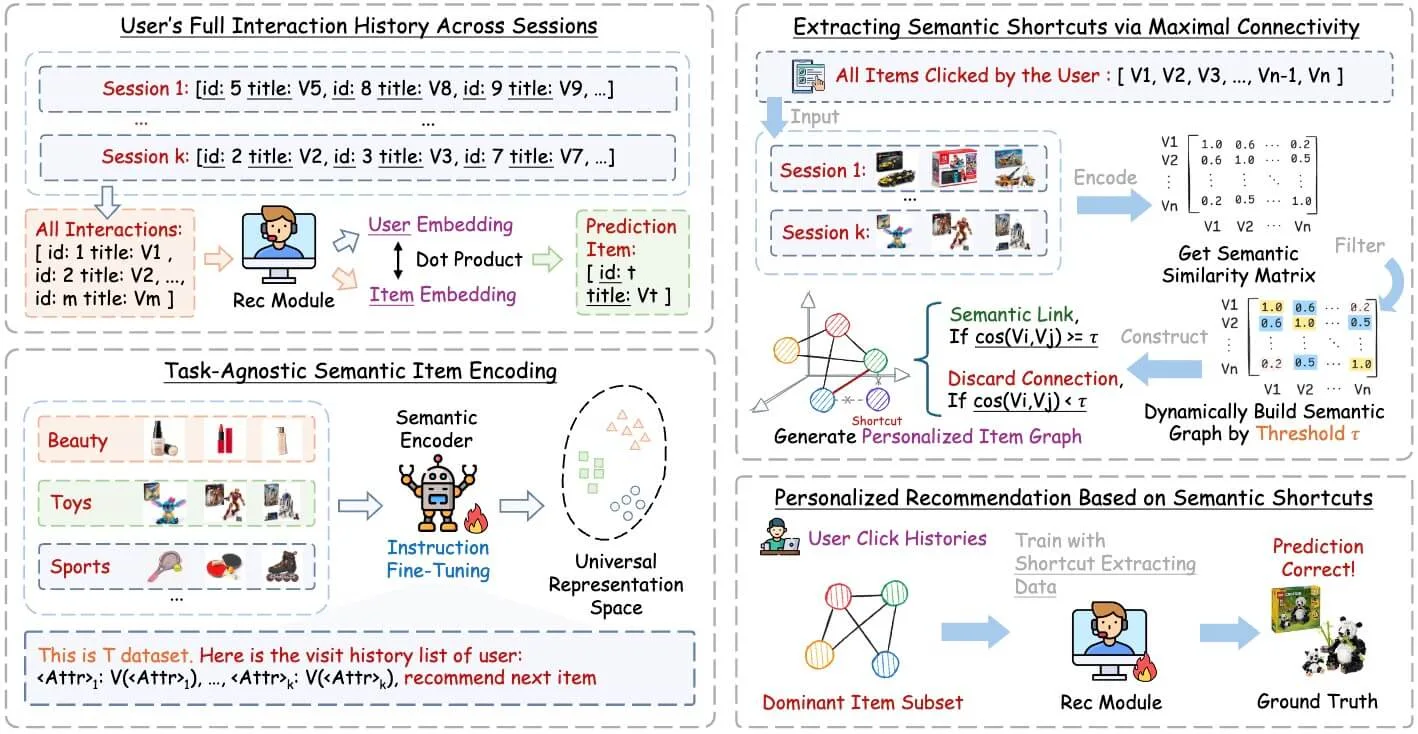

LISRec: Modeling User Preferences with Learned Item Shortcuts for Sequential Recommendation

Haidong Xin, Zhenghao Liu$^†$, Sen Mei, Yukun Yan, Shi Yu, Shuo Wang, Zulong Chen, Yu Gu, Ge Yu, Chenyan Xiong

Diese Arbeit verbessert sequenzielle Empfehlungssysteme, indem personalisierte semantische Abkürzungen aus Nutzer-Item-Interaktionshistorien extrahiert werden, wodurch stabile Präferenzen besser erfasst werden.

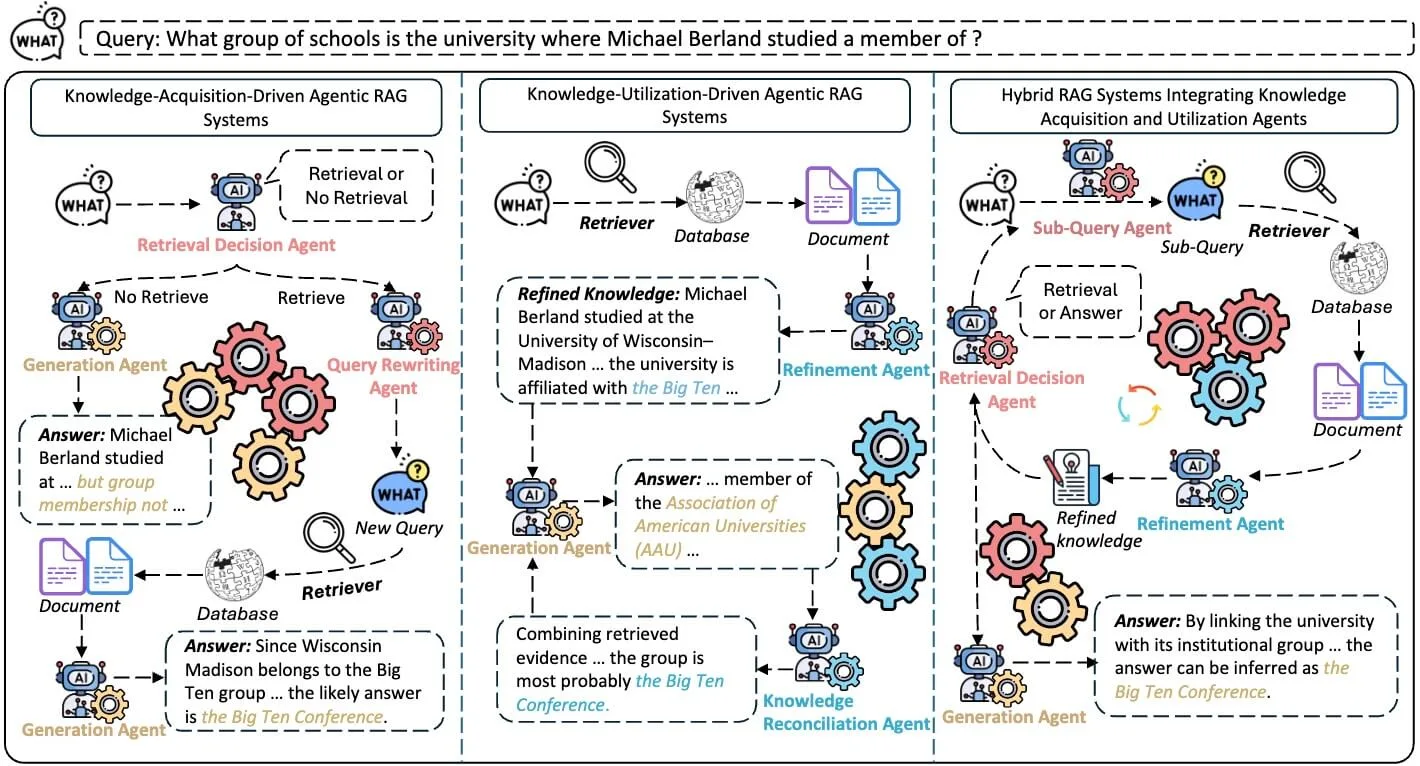

Knowledge Intensive Agents

Zhenghao Liu, Pengcheng Huang, Zhipeng Xu, Xinze Li, Shuliang Liu, Chunyi Peng, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Xu Han, Zhiyuan Liu$^†$, Maosong Sun$^†$, Yu Gu, Ge Yu

Diese Arbeit bietet einen umfassenden Überblick über Retrieval-Augmented Generation aus agentischer Perspektive, kategorisiert wissensintensive Agenten nach Wissensakquise und -nutzung und hebt zukünftige Richtungen für die gemeinsame Optimierung in Multi-Agent-RAG-Systemen hervor.

Adapting Language Models to Text Matching based Recommendation Systems

Haidong Xin, Sen Mei, Zhenghao Liu$^†$, Xiaohua Li, Minghe Yu, Yu Gu, Ge Yu

Diese Arbeit verbessert die Leistung von Text-Matching in Empfehlungssystemen deutlich, indem Vortraining mit Sprachmodellen integriert wird.

LLMsPark: A Benchmark for Evaluating Large Language Models in Strategic Gaming Contexts

Junhao Chen, Jingbo Sun, Xiang Li, Haidong Xin, Yuhao Xue, Yibin Xu, Hao Zhao$^†$

Diese Arbeit führt LLMsPark ein, eine auf Spieltheorie basierende Plattform zur Bewertung strategischer Verhaltensweisen und Entscheidungsfähigkeiten großer Sprachmodelle in Multi-Agenten-Umgebungen.

MMAD: Multi-modal Movie Audio Description

Xiaojun Ye, Junhao Chen, Xiang Li, Haidong Xin, Chao Li, Sheng Zhou$^†$, Jiajun Bu

Diese Arbeit hat für sehbehinderte Menschen ein völlig neues Filmerlebnis erschlossen.

Puzzle Game: Prediction and Classification of Wordle Solution Words

Haidong Xin$^{*†}$, Fang Wu$^{*}$, Zhitong Zhou$^{*}$

Diese Arbeit führte eine detaillierte numerische Analyse des Spiels Wordle durch und legte die darin verborgenen statistischen Muster offen.

🏆 Auszeichnungen

- 2025.11 🥇 Exzellenzstipendium für Studierende, 1. Preis

- 2024.11 🥇 Exzellenzstipendium für Studierende, 1. Preis

- 2023.07 🥈 Nationaler 2. Preis beim Chinese Collegiate Computing Competition (4C 2023)

- 2023.05 🥈 Honorable Mention beim Mathematical Contest in Modeling (MCM/ICM 2023)

- 2023.05 🥈 2. Preis beim internationalen Innovationswettbewerb für Studierende

- 2022.11 🥇 1. Preis beim China Undergraduate Mathematical Contest in Modeling (CUMCM 2022)

- 2022.10 🥈 2. Preis in der Mathematikmodellierungs-Liga der drei nordöstlichen Provinzen

- 2022.05 🥇 Exzellenzstipendium für Studierende, 1. Preis

- 2021.05 🥇 Exzellenzstipendium für Studierende, 1. Preis

📖 Bildungsweg

- 2024.09 - heute, M.Sc. in Informatik, School of Computer Science and Engineering, Northeastern University

- 2020.09 - 2024.06, B.Sc. in Informatik, College of Computer Science and Technology, Harbin Engineering University

- 2017.09 - 2020.06, Yichun No.1 Middle School

💬 Medienberichte

- 2026.01, 【TsinghuaNLP】成果 | UltraRAG 3.0:拒绝“盲盒”开发,让每一行推理逻辑都清晰可见

- 2025.11, 【TsinghuaNLP】成果 | UltraRAG 2.1:强化知识接入与多模态支持,完善统一评估体系

- 2025.08, 【TsinghuaNLP】成果 | UltraRAG 2.0:几十行代码实现高性能 RAG,让科研专注思想创新

- 2025.01, 【喜报】一封来自哈尔滨工程大学写给伊春市第一中学的喜报

- 2024.06, 【一院一节】第三届“贡橙杯” CTF竞赛圆满落幕

- 2023.12, 【一院一节】第二届“贡橙杯” CTF竞赛圆满落幕

- 2023.07, 【一院一节】第一届“贡橙杯” CTF竞赛圆满落幕

- 2023.05, 【苏州同元软控信息技术有限公司】MoHub平台支持工科教学

💻 Forschung und Praktika

- 2024.04 - heute, Qiyuan Lab (TsinghuaNLP), Peking.

- 2024.10 - 2025.02, Language Technologies Institute (LTI), Carnegie Mellon University, remote.

- 2023.10 - heute, NEUIR Lab, Northeastern University, Shenyang.

- 2023.05 - 2023.06, China Unicom Research Centre, Harbin.

- 2023.07 - 2023.08, Workforce Development Program (WDP) of Oracle, Harbin.

- 2022.09 - 2024.06, E-Government Modeling Simulation National Engineering Laboratory, Harbin.