👋 Actualmente curso un máster en Informática en Northeastern University. Mis intereses de investigación abarcan PLN, recuperación de información, Retrieval-Augmented Generation, sistemas de recomendación y sistemas multiagente. Mi perfil de Google Scholar puede consultarse aquí

🎓 Obtuve la licenciatura en Ciencias de la Computación en Harbin Engineering University. Ahora realizo el máster en NEUIR Lab, bajo la supervisión del profesor asociado Zhenghao Liu. También colaboro estrechamente con Qiyuan Lab  , ModelBest

, ModelBest

, con la mentoría del investigador asociado Yukun Yan.

, con la mentoría del investigador asociado Yukun Yan.

🔥 Les invitamos sinceramente a probar y contribuir a nuestro nuevo proyecto, UltraRAG v3!

🔥 Sus comentarios, ideas y contribuciones serán muy bienvenidos.

🔥 Noticias

- 2026.02: 🎉 Nuestro artículo Knowledge Intensive Agents fue aceptado por AI Open (IF=14.8)!

- 2026.01: 🎉 UltraRAG v3

alcanzó el puesto n.º 2 en GitHub Trending!

- 2026.01: 🎉 Publicamos UltraRAG v3, haciendo visible cada paso del razonamiento!

- 2025.11: 🎉 Nuestro artículo LISRec fue aceptado en KDD 2026 (CCF-A)!

- 2025.11: 🎉 Publicamos UltraRAG v2.1, con soporte multimodal y un flujo de evaluación más unificado!

- 2025.08: 🎉 Publicamos UltraRAG v2, un framework low-code para construir sistemas RAG complejos!

- 2025.08: 🎉 Nuestro artículo TASTE$^+$ fue aceptado en WISA 2025 y seleccionado para una presentación oral!

- 2025.08: 🎉 Nuestro artículo LLMsPark fue aceptado en EMNLP 2025 (CCF-B)!

- 2024.04: 🎉 Publicamos el repositorio de GitHub heu-icicles

y les invitamos cordialmente a contribuir!

- 2024.02: 🎉 Nuestro artículo MMAD fue aceptado en COLING 2024 (CCF-B)!

- 2023.05: 🎉 Nuestro artículo recibió el Honorable Mention Award en MCM/ICM 2023!

📝 Publicaciones

* indica contribución equitativa, y † indica el autor de correspondencia.

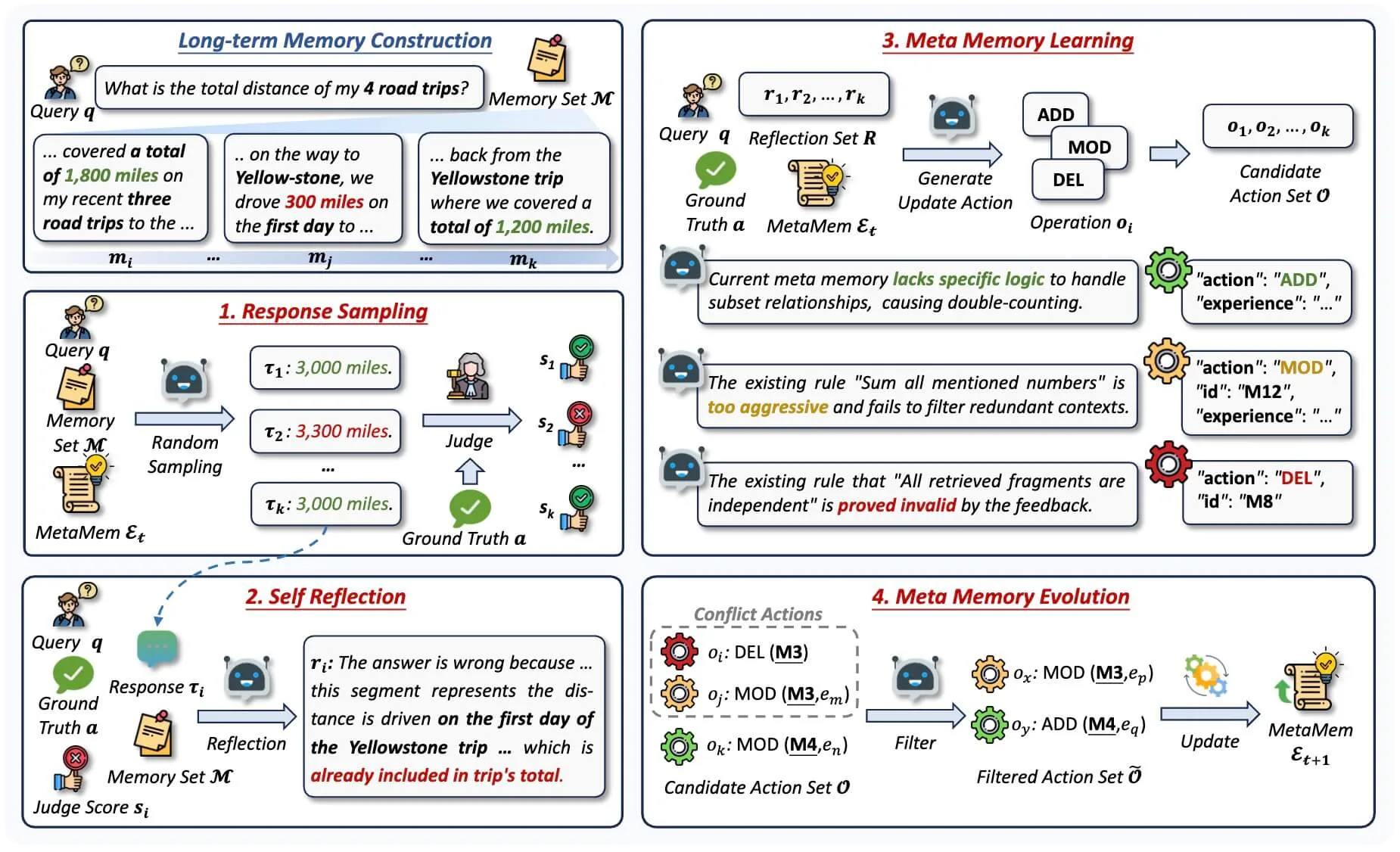

MetaMem: Evolving Meta-Memory for Knowledge Utilization through Self-Reflective Symbolic Optimization

Haidong Xin$^{*}$, Xinze Li$^{*}$, Zhenghao Liu$^†$, Yukun Yan$^†$, Shuo Wang, Cheng Yang, Yu Gu, Ge Yu, Maosong Sun

Este trabajo propone MetaMem, un marco de meta-memoria que evoluciona mediante optimización simbólica autorreflexiva, permitiendo un mejor aprovechamiento del conocimiento en interacciones humano-LLM de largo horizonte.

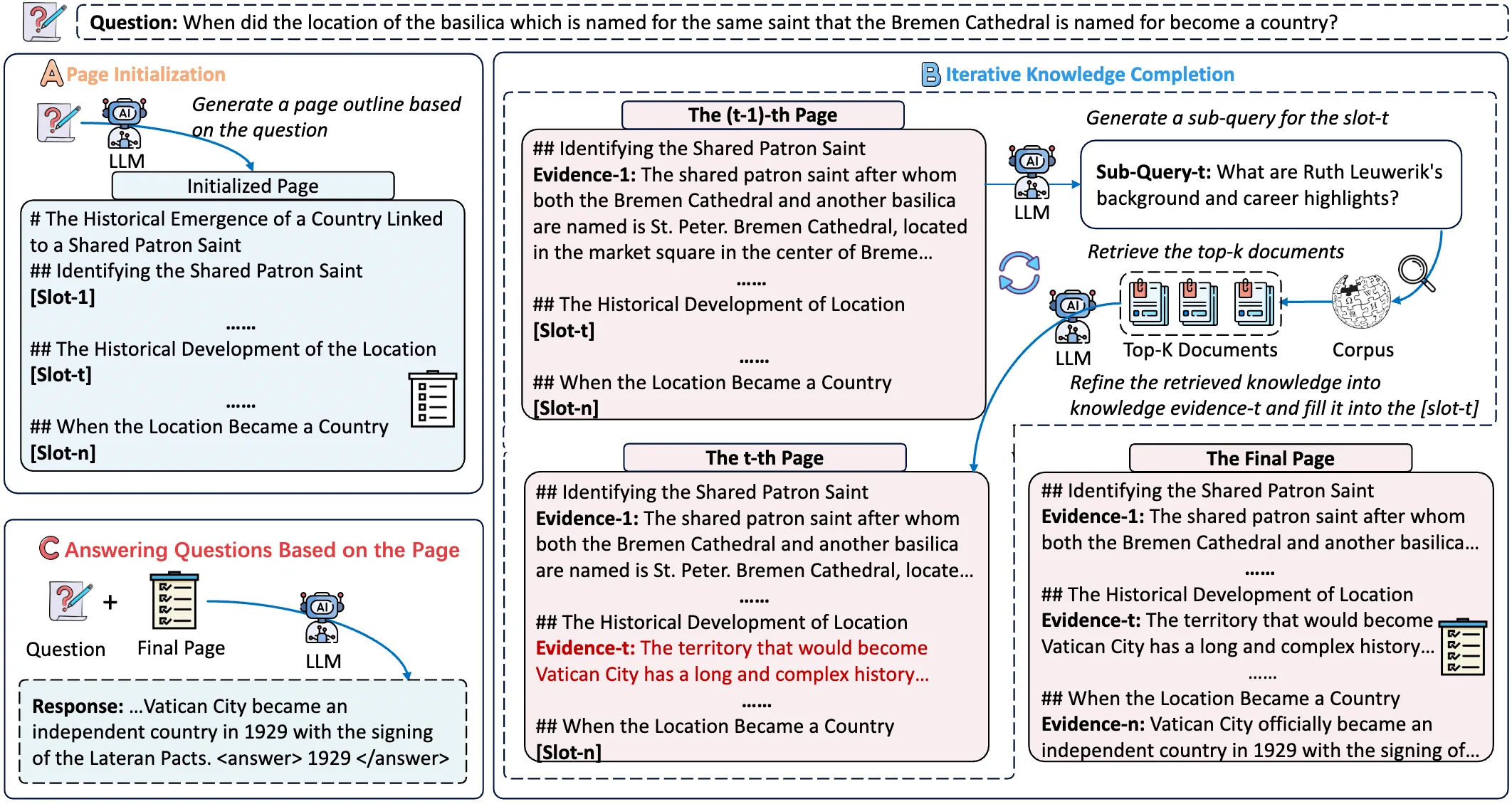

Structured Knowledge Representation through Contextual Pages for Retrieval-Augmented Generation

Xinze Li, Zhenghao Liu$^†$, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Zheni Zeng, Sen Mei, Ge Yu, Maosong Sun

Este trabajo mejora los sistemas RAG al construir esquemas cognitivos estructurados para guiar la recuperación iterativa, organizando conocimiento multidimensional en páginas coherentes para generar respuestas más precisas.

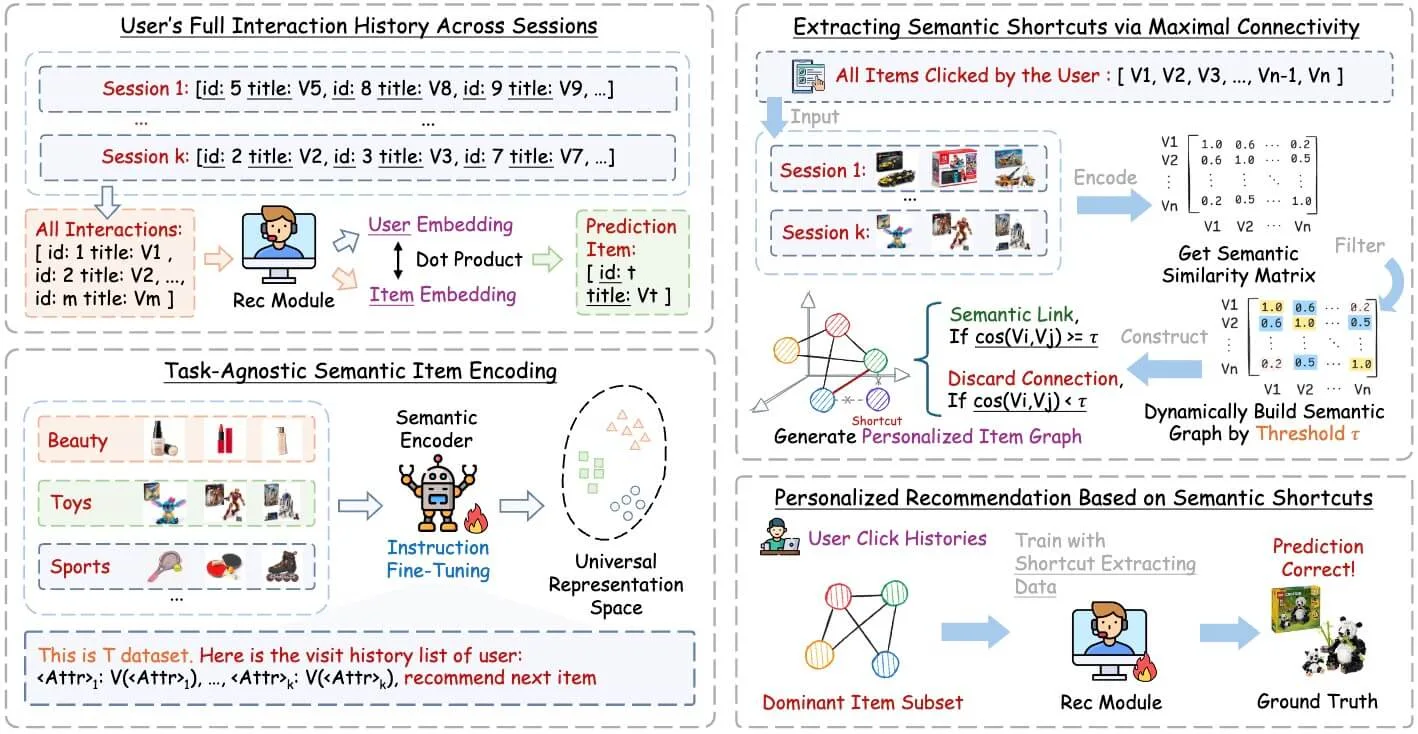

LISRec: Modeling User Preferences with Learned Item Shortcuts for Sequential Recommendation

Haidong Xin, Zhenghao Liu$^†$, Sen Mei, Yukun Yan, Shi Yu, Shuo Wang, Zulong Chen, Yu Gu, Ge Yu, Chenyan Xiong

Este trabajo mejora los sistemas de recomendación secuencial extrayendo atajos semánticos personalizados a partir del historial de interacciones usuario-ítem, lo que permite captar mejor las preferencias estables.

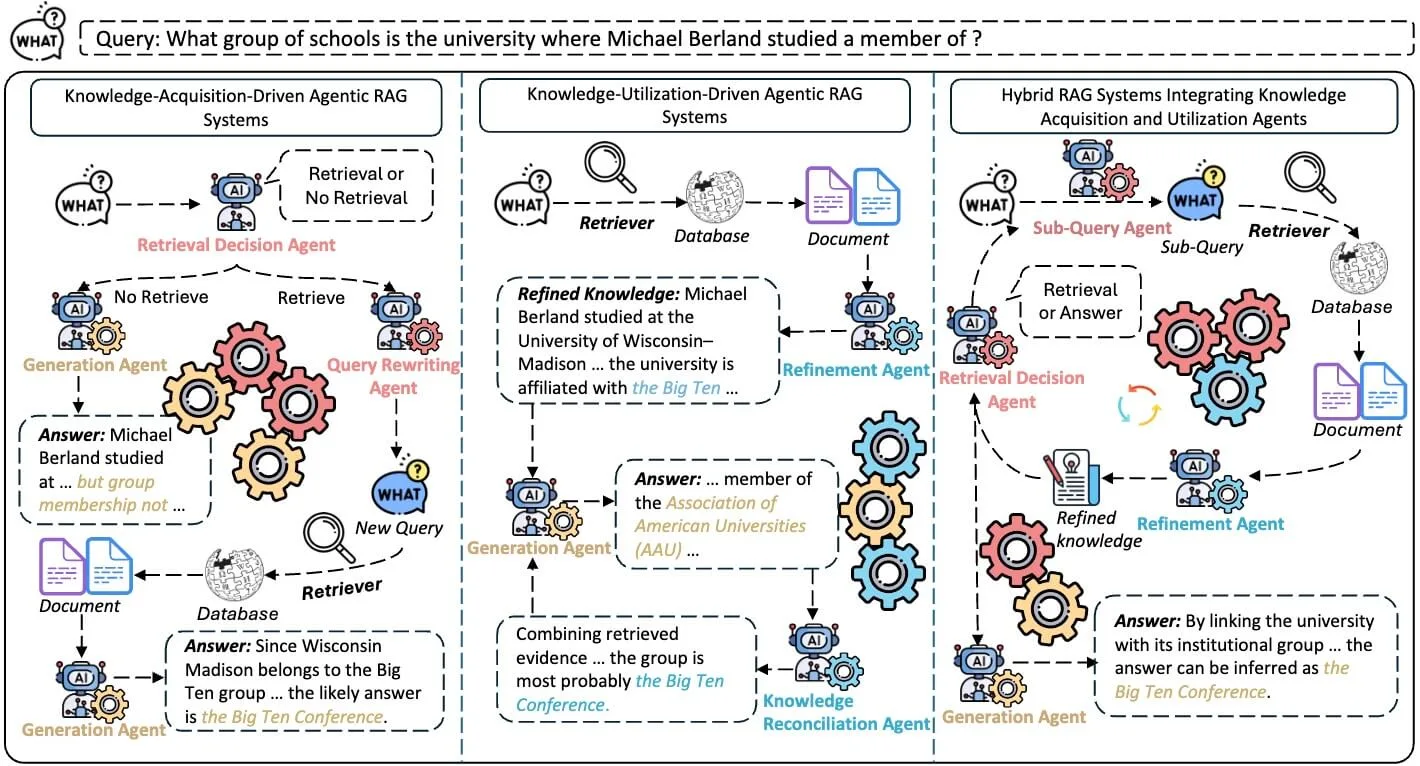

Knowledge Intensive Agents

Zhenghao Liu, Pengcheng Huang, Zhipeng Xu, Xinze Li, Shuliang Liu, Chunyi Peng, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Xu Han, Zhiyuan Liu$^†$, Maosong Sun$^†$, Yu Gu, Ge Yu

Este trabajo ofrece una visión general completa de Retrieval-Augmented Generation desde una perspectiva de agentes, clasificando a los agentes intensivos en conocimiento en roles de adquisición y utilización, y destacando futuras direcciones para la optimización conjunta en sistemas RAG multiagente.

Adapting Language Models to Text Matching based Recommendation Systems

Haidong Xin, Sen Mei, Zhenghao Liu$^†$, Xiaohua Li, Minghe Yu, Yu Gu, Ge Yu

Este trabajo ha mejorado significativamente el rendimiento del emparejamiento de textos en sistemas de recomendación al incorporar el preentrenamiento de modelos de lenguaje.

LLMsPark: A Benchmark for Evaluating Large Language Models in Strategic Gaming Contexts

Junhao Chen, Jingbo Sun, Xiang Li, Haidong Xin, Yuhao Xue, Yibin Xu, Hao Zhao$^†$

Este trabajo presenta LLMsPark, una plataforma basada en teoría de juegos para evaluar los comportamientos estratégicos y la capacidad de toma de decisiones de grandes modelos de lenguaje en entornos multiagente.

MMAD: Multi-modal Movie Audio Description

Xiaojun Ye, Junhao Chen, Xiang Li, Haidong Xin, Chao Li, Sheng Zhou$^†$, Jiajun Bu

Este trabajo ha abierto una experiencia completamente nueva de ver películas para personas con discapacidad visual.

Puzzle Game: Prediction and Classification of Wordle Solution Words

Haidong Xin$^{*†}$, Fang Wu$^{*}$, Zhitong Zhou$^{*}$

Este trabajo realizó un análisis numérico detallado del juego Wordle, revelando los patrones estadísticos presentes en él.

🏆 Premios

- 2025.11 🥇 Beca de excelencia estudiantil, primer premio

- 2024.11 🥇 Beca de excelencia estudiantil, primer premio

- 2023.07 🥈 Segundo premio nacional del Chinese Collegiate Computing Competition (4C 2023)

- 2023.05 🥈 Honorable Mention en el Mathematical Contest in Modeling (MCM/ICM 2023)

- 2023.05 🥈 Segundo premio del concurso internacional de innovación estudiantil

- 2022.11 🥇 Primer premio del China Undergraduate Mathematical Contest in Modeling (CUMCM 2022)

- 2022.10 🥈 Segundo premio de la liga de modelado matemático de las tres provincias del noreste

- 2022.05 🥇 Beca de excelencia estudiantil, primer premio

- 2021.05 🥇 Beca de excelencia estudiantil, primer premio

📖 Formación académica

- 2024.09 - presente, Máster en Informática, School of Computer Science and Engineering, Northeastern University

- 2020.09 - 2024.06, Grado en Ciencias de la Computación, College of Computer Science and Technology, Harbin Engineering University

- 2017.09 - 2020.06, Yichun No.1 Middle School

💬 Menciones en medios

- 2026.01, 【TsinghuaNLP】成果 | UltraRAG 3.0:拒绝“盲盒”开发,让每一行推理逻辑都清晰可见

- 2025.11, 【TsinghuaNLP】成果 | UltraRAG 2.1:强化知识接入与多模态支持,完善统一评估体系

- 2025.08, 【TsinghuaNLP】成果 | UltraRAG 2.0:几十行代码实现高性能 RAG,让科研专注思想创新

- 2025.01, 【喜报】一封来自哈尔滨工程大学写给伊春市第一中学的喜报

- 2024.06, 【一院一节】第三届“贡橙杯” CTF竞赛圆满落幕

- 2023.12, 【一院一节】第二届“贡橙杯” CTF竞赛圆满落幕

- 2023.07, 【一院一节】第一届“贡橙杯” CTF竞赛圆满落幕

- 2023.05, 【苏州同元软控信息技术有限公司】MoHub平台支持工科教学

💻 Investigación y prácticas

- 2024.04 - presente, Qiyuan Lab (TsinghuaNLP), Pekín.

- 2024.10 - 2025.02, Language Technologies Institute (LTI), Carnegie Mellon University, en remoto.

- 2023.10 - presente, NEUIR Lab, Northeastern University, Shenyang.

- 2023.05 - 2023.06, China Unicom Research Centre, Harbin.

- 2023.07 - 2023.08, Workforce Development Program (WDP) of Oracle, Harbin.

- 2022.09 - 2024.06, E-Government Modeling Simulation National Engineering Laboratory, Harbin.