👋 Frequento atualmente o mestrado em Ciência da Computação na Northeastern University. Os meus interesses de investigação abrangem NLP, recuperação de informação, Retrieval-Augmented Generation, sistemas de recomendação e sistemas multiagente. O meu perfil de Google Scholar está disponível aqui

🎓 Concluí a licenciatura em Ciência da Computação na Harbin Engineering University. Agora frequento o mestrado no NEUIR Lab, sob orientação do professor associado Zhenghao Liu. Também colaboro de perto com Qiyuan Lab  , ModelBest

, ModelBest

, contando também com a mentoria do investigador associado Yukun Yan.

, contando também com a mentoria do investigador associado Yukun Yan.

🔥 Convidamo-lo sinceramente a experimentar e a contribuir para o nosso novo projecto, UltraRAG v3!

🔥 O seu feedback, as suas ideias e as suas contribuições são muito bem-vindos.

🔥 Notícias

- 2026.02: 🎉 O nosso artigo Knowledge Intensive Agents foi aceite pela AI Open (IF=14.8)!

- 2026.01: 🎉 UltraRAG v3

alcançou o 2.º lugar no GitHub Trending!

- 2026.01: 🎉 Lançámos o UltraRAG v3, tornando visível cada etapa do raciocínio!

- 2025.11: 🎉 O nosso artigo LISRec foi aceite na KDD 2026 (CCF-A)!

- 2025.11: 🎉 Lançámos o UltraRAG v2.1, com suporte multimodal e um fluxo de avaliação mais coerente!

- 2025.08: 🎉 Lançámos o UltraRAG v2, uma framework low-code para construir sistemas RAG complexos!

- 2025.08: 🎉 O nosso artigo TASTE$^+$ foi aceite na WISA 2025 e seleccionado para uma apresentação oral!

- 2025.08: 🎉 O nosso artigo LLMsPark foi aceite na EMNLP 2025 (CCF-B)!

- 2024.04: 🎉 Publicámos o repositório GitHub heu-icicles

e convidamo-lo a contribuir!

- 2024.02: 🎉 O nosso artigo MMAD foi aceite na COLING 2024 (CCF-B)!

- 2023.05: 🎉 O nosso artigo recebeu a Honorable Mention Award na MCM/ICM 2023!

📝 Publicações

* indica contribuição igual, e † indica o autor correspondente.

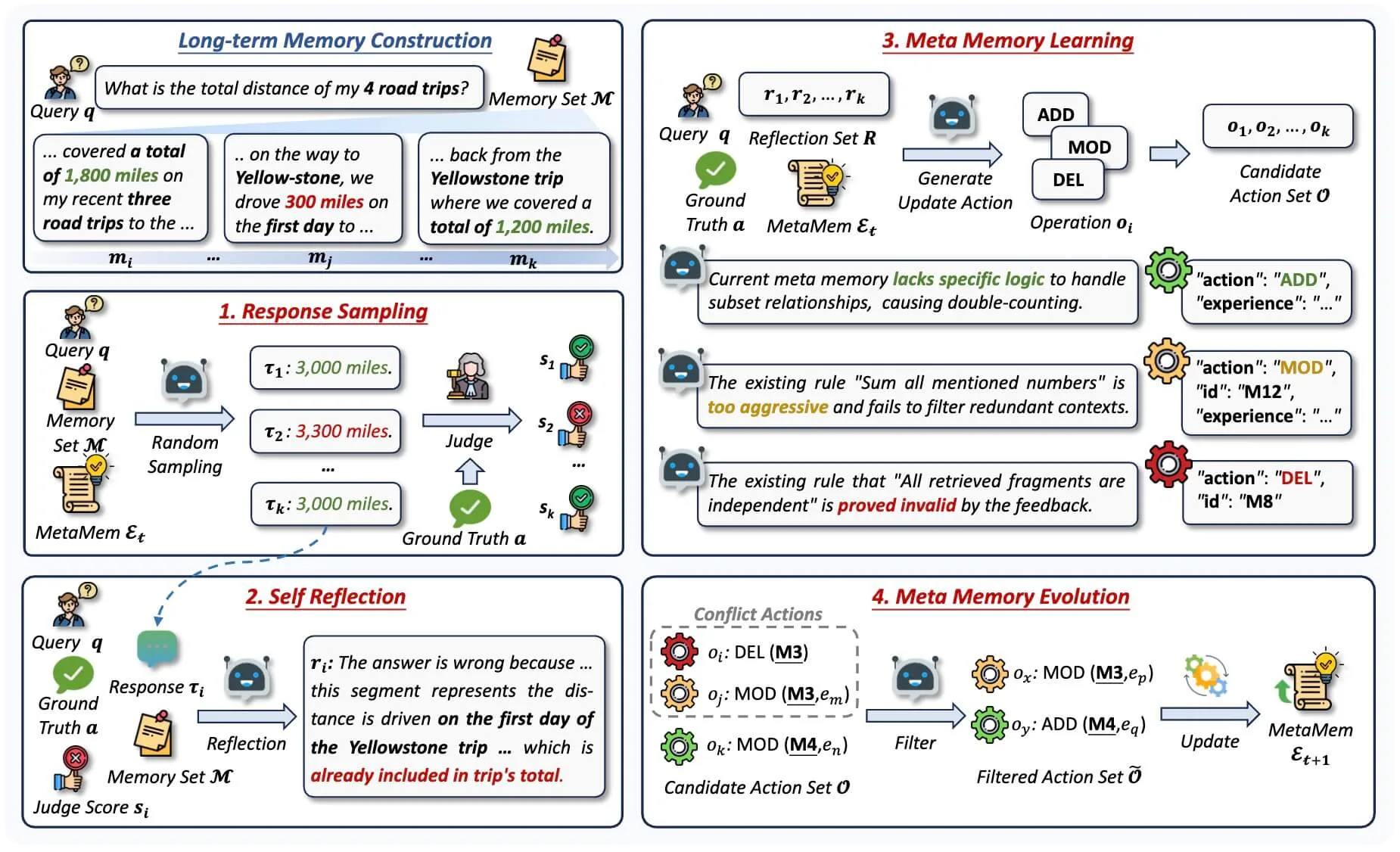

MetaMem: Evolving Meta-Memory for Knowledge Utilization through Self-Reflective Symbolic Optimization

Haidong Xin$^{*}$, Xinze Li$^{*}$, Zhenghao Liu$^†$, Yukun Yan$^†$, Shuo Wang, Cheng Yang, Yu Gu, Ge Yu, Maosong Sun

Este trabalho propõe o MetaMem, uma estrutura de meta-memória que evolui através de optimização simbólica auto-reflexiva, permitindo uma melhor utilização do conhecimento em interacções humano-LLM de longo prazo.

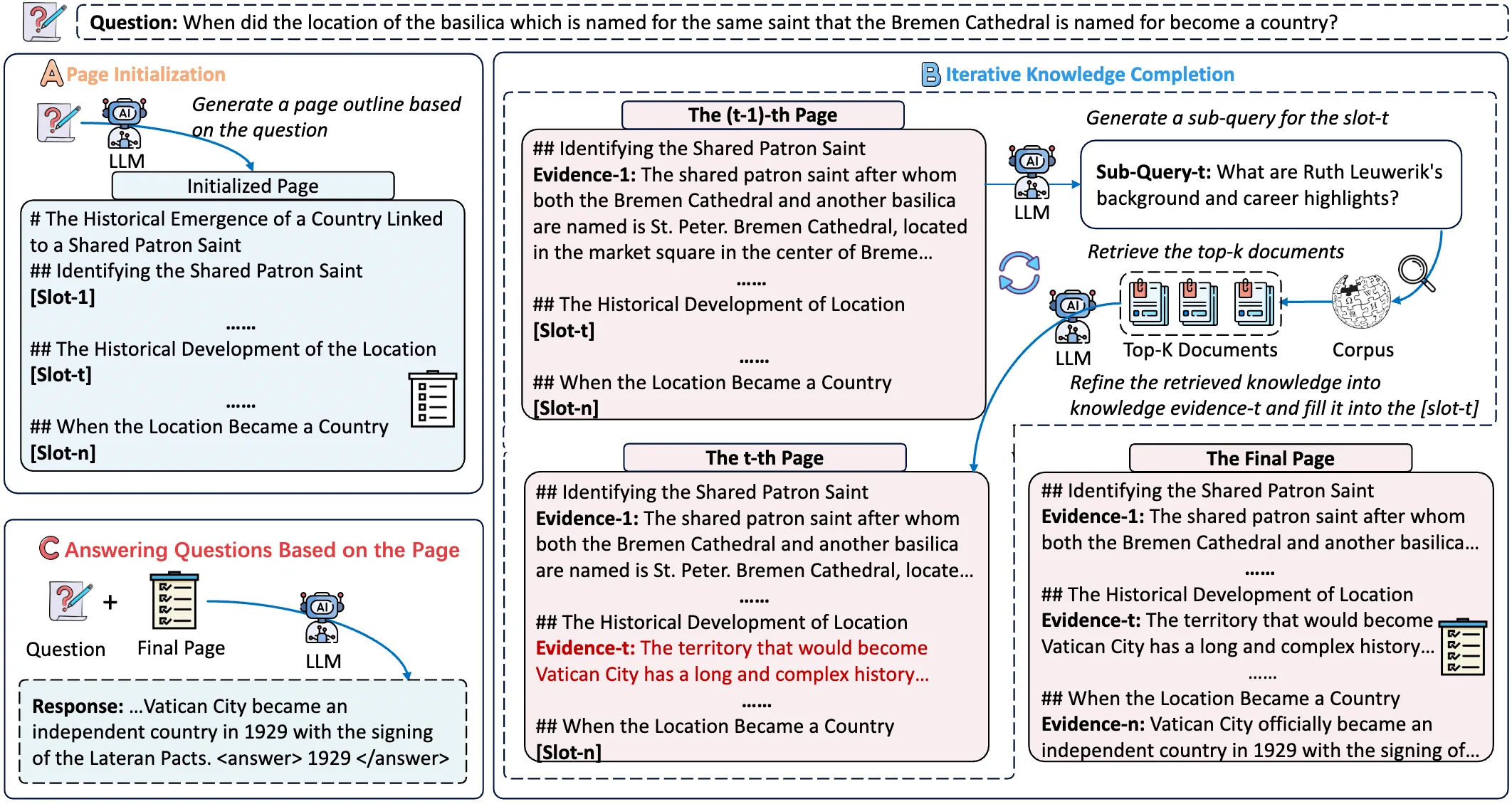

Structured Knowledge Representation through Contextual Pages for Retrieval-Augmented Generation

Xinze Li, Zhenghao Liu$^†$, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Zheni Zeng, Sen Mei, Ge Yu, Maosong Sun

Este trabalho reforça os sistemas RAG ao construir esquemas cognitivos estruturados para orientar a recuperação iterativa, organizando conhecimento multidimensional em páginas coerentes para gerar respostas mais precisas.

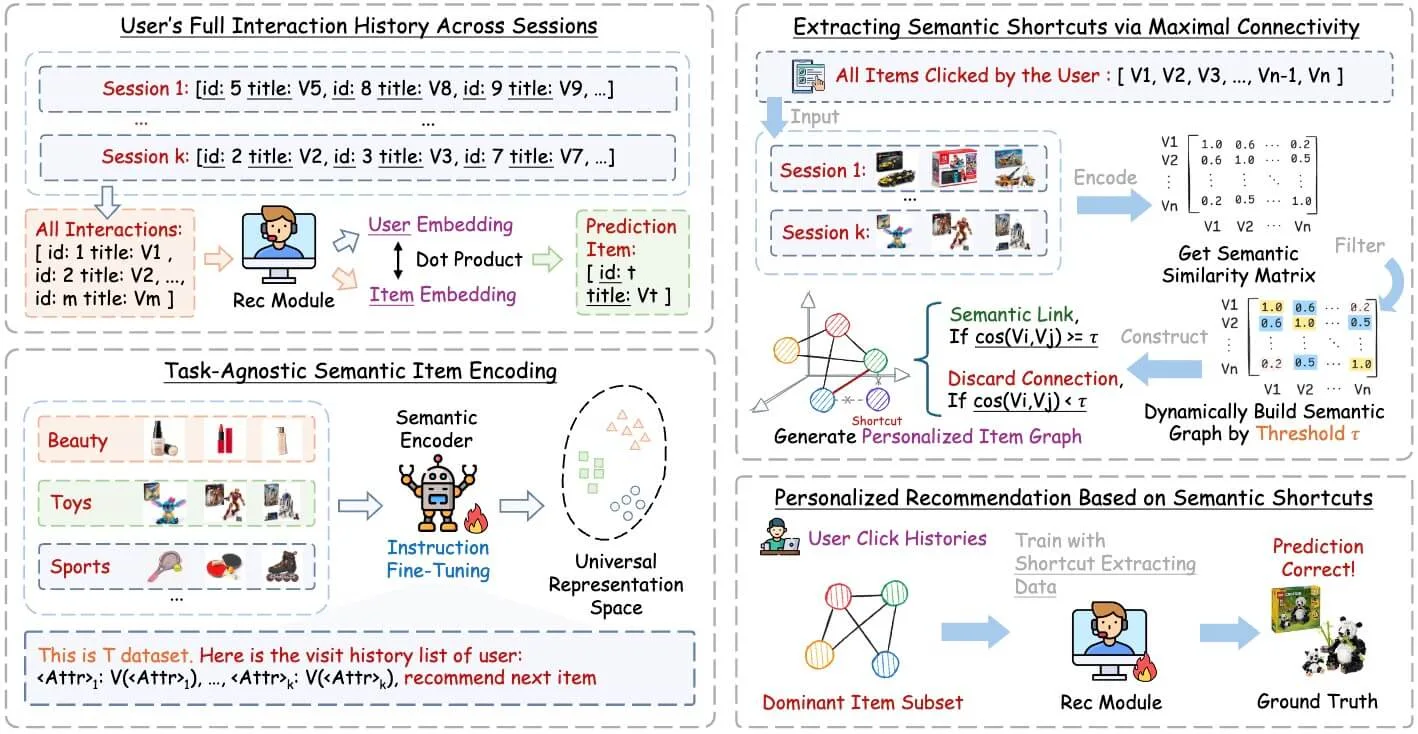

LISRec: Modeling User Preferences with Learned Item Shortcuts for Sequential Recommendation

Haidong Xin, Zhenghao Liu$^†$, Sen Mei, Yukun Yan, Shi Yu, Shuo Wang, Zulong Chen, Yu Gu, Ge Yu, Chenyan Xiong

Este trabalho melhora os sistemas de recomendação sequencial ao extrair atalhos semânticos personalizados a partir do histórico de interacções utilizador-item, captando melhor preferências estáveis.

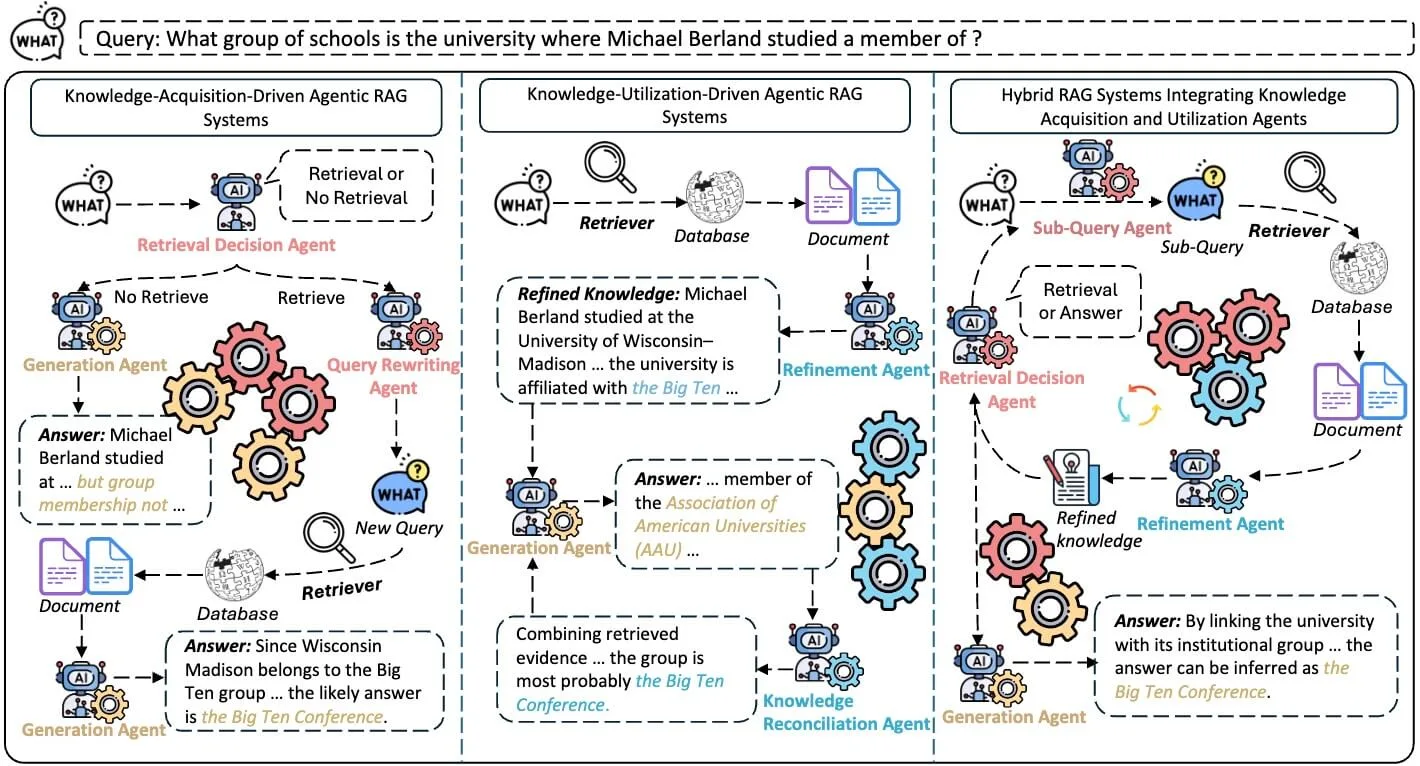

Knowledge Intensive Agents

Zhenghao Liu, Pengcheng Huang, Zhipeng Xu, Xinze Li, Shuliang Liu, Chunyi Peng, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Xu Han, Zhiyuan Liu$^†$, Maosong Sun$^†$, Yu Gu, Ge Yu

Este trabalho oferece uma visão abrangente do Retrieval-Augmented Generation a partir de uma perspectiva agentiva, categorizando agentes intensivos em conhecimento em aquisição e utilização e destacando direcções futuras para a optimização conjunta em sistemas RAG multiagente.

Adapting Language Models to Text Matching based Recommendation Systems

Haidong Xin, Sen Mei, Zhenghao Liu$^†$, Xiaohua Li, Minghe Yu, Yu Gu, Ge Yu

Este trabalho melhorou significativamente o desempenho do text matching em sistemas de recomendação ao incorporar pré-treino de modelos de linguagem.

LLMsPark: A Benchmark for Evaluating Large Language Models in Strategic Gaming Contexts

Junhao Chen, Jingbo Sun, Xiang Li, Haidong Xin, Yuhao Xue, Yibin Xu, Hao Zhao$^†$

Este trabalho apresenta o LLMsPark, uma plataforma baseada em teoria dos jogos para avaliar comportamentos estratégicos e capacidades de decisão de grandes modelos de linguagem em ambientes multiagente.

MMAD: Multi-modal Movie Audio Description

Xiaojun Ye, Junhao Chen, Xiang Li, Haidong Xin, Chao Li, Sheng Zhou$^†$, Jiajun Bu

Este trabalho abriu uma experiência totalmente nova de ver filmes para pessoas com deficiência visual.

Puzzle Game: Prediction and Classification of Wordle Solution Words

Haidong Xin$^{*†}$, Fang Wu$^{*}$, Zhitong Zhou$^{*}$

Este trabalho realizou uma análise numérica detalhada do jogo Wordle, revelando os padrões estatísticos nele contidos.

🏆 Prémios

- 2025.11 🥇 Bolsa de Excelência Estudantil, 1.º prémio

- 2024.11 🥇 Bolsa de Excelência Estudantil, 1.º prémio

- 2023.07 🥈 Segundo prémio nacional no Chinese Collegiate Computing Competition (4C 2023)

- 2023.05 🥈 Honorable Mention no Mathematical Contest in Modeling (MCM/ICM 2023)

- 2023.05 🥈 Segundo prémio da Competição Internacional de Inovação Estudantil

- 2022.11 🥇 Primeiro prémio no China Undergraduate Mathematical Contest in Modeling (CUMCM 2022)

- 2022.10 🥈 Segundo prémio da Liga de Modelação Matemática das Três Províncias do Nordeste

- 2022.05 🥇 Bolsa de Excelência Estudantil, 1.º prémio

- 2021.05 🥇 Bolsa de Excelência Estudantil, 1.º prémio

📖 Formação académica

- 2024.09 - presente, Mestrado em Ciência da Computação, School of Computer Science and Engineering, Northeastern University

- 2020.09 - 2024.06, Licenciatura em Ciência da Computação, College of Computer Science and Technology, Harbin Engineering University

- 2017.09 - 2020.06, Yichun No.1 Middle School

💬 Menções na imprensa

- 2026.01, 【TsinghuaNLP】成果 | UltraRAG 3.0:拒绝“盲盒”开发,让每一行推理逻辑都清晰可见

- 2025.11, 【TsinghuaNLP】成果 | UltraRAG 2.1:强化知识接入与多模态支持,完善统一评估体系

- 2025.08, 【TsinghuaNLP】成果 | UltraRAG 2.0:几十行代码实现高性能 RAG,让科研专注思想创新

- 2025.01, 【喜报】一封来自哈尔滨工程大学写给伊春市第一中学的喜报

- 2024.06, 【一院一节】第三届“贡橙杯” CTF竞赛圆满落幕

- 2023.12, 【一院一节】第二届“贡橙杯” CTF竞赛圆满落幕

- 2023.07, 【一院一节】第一届“贡橙杯” CTF竞赛圆满落幕

- 2023.05, 【苏州同元软控信息技术有限公司】MoHub平台支持工科教学

💻 Investigação e estágios

- 2024.04 - presente, Qiyuan Lab (TsinghuaNLP), Pequim.

- 2024.10 - 2025.02, Language Technologies Institute (LTI), Carnegie Mellon University, remoto.

- 2023.10 - presente, NEUIR Lab, Northeastern University, Shenyang.

- 2023.05 - 2023.06, China Unicom Research Centre, Harbin.

- 2023.07 - 2023.08, Workforce Development Program (WDP) of Oracle, Harbin.

- 2022.09 - 2024.06, E-Government Modeling Simulation National Engineering Laboratory, Harbin.