👋 Сейчас я учусь в магистратуре по компьютерным наукам в Northeastern University. Мои научные интересы охватывают NLP, информационный поиск, Retrieval-Augmented Generation, рекомендательные системы и мультиагентные системы. Мой профиль Google Scholar можно посмотреть здесь

🎓 Я получил степень бакалавра по компьютерным наукам в Harbin Engineering University. Сейчас я учусь в магистратуре в NEUIR Lab под руководством доцента Zhenghao Liu. Я также тесно сотрудничаю с Qiyuan Lab  , ModelBest

, ModelBest

, а также получаю наставничество от Associate Researcher Yukun Yan.

, а также получаю наставничество от Associate Researcher Yukun Yan.

🔥 Мы искренне приглашаем вас попробовать и поддержать наш новый проект UltraRAG v3!

🔥 Мы будем рады вашим отзывам, идеям и вкладу.

🔥 Новости

- 2026.02: 🎉 Наша статья Knowledge Intensive Agents принята в AI Open (IF=14.8)!

- 2026.01: 🎉 UltraRAG v3

поднялся на 2-е место в GitHub Trending!

- 2026.01: 🎉 Мы выпустили UltraRAG v3, сделав прозрачным каждый шаг рассуждений!

- 2025.11: 🎉 Наша статья LISRec принята на KDD 2026 (CCF-A)!

- 2025.11: 🎉 Мы выпустили UltraRAG v2.1, добавив мультимодальную поддержку и более единый контур оценки!

- 2025.08: 🎉 Мы выпустили UltraRAG v2, low-code фреймворк для построения сложных RAG-систем!

- 2025.08: 🎉 Наша статья TASTE$^+$ принята на WISA 2025 и отобрана для устного доклада!

- 2025.08: 🎉 Наша статья LLMsPark принята на EMNLP 2025 (CCF-B)!

- 2024.04: 🎉 Мы выпустили GitHub-репозиторий heu-icicles

и тепло приглашаем вас присоединиться к разработке!

- 2024.02: 🎉 Наша статья MMAD принята на COLING 2024 (CCF-B)!

- 2023.05: 🎉 Наша статья получила Honorable Mention на MCM/ICM 2023!

📝 Публикации

* означает равный вклад, а † означает автора для переписки.

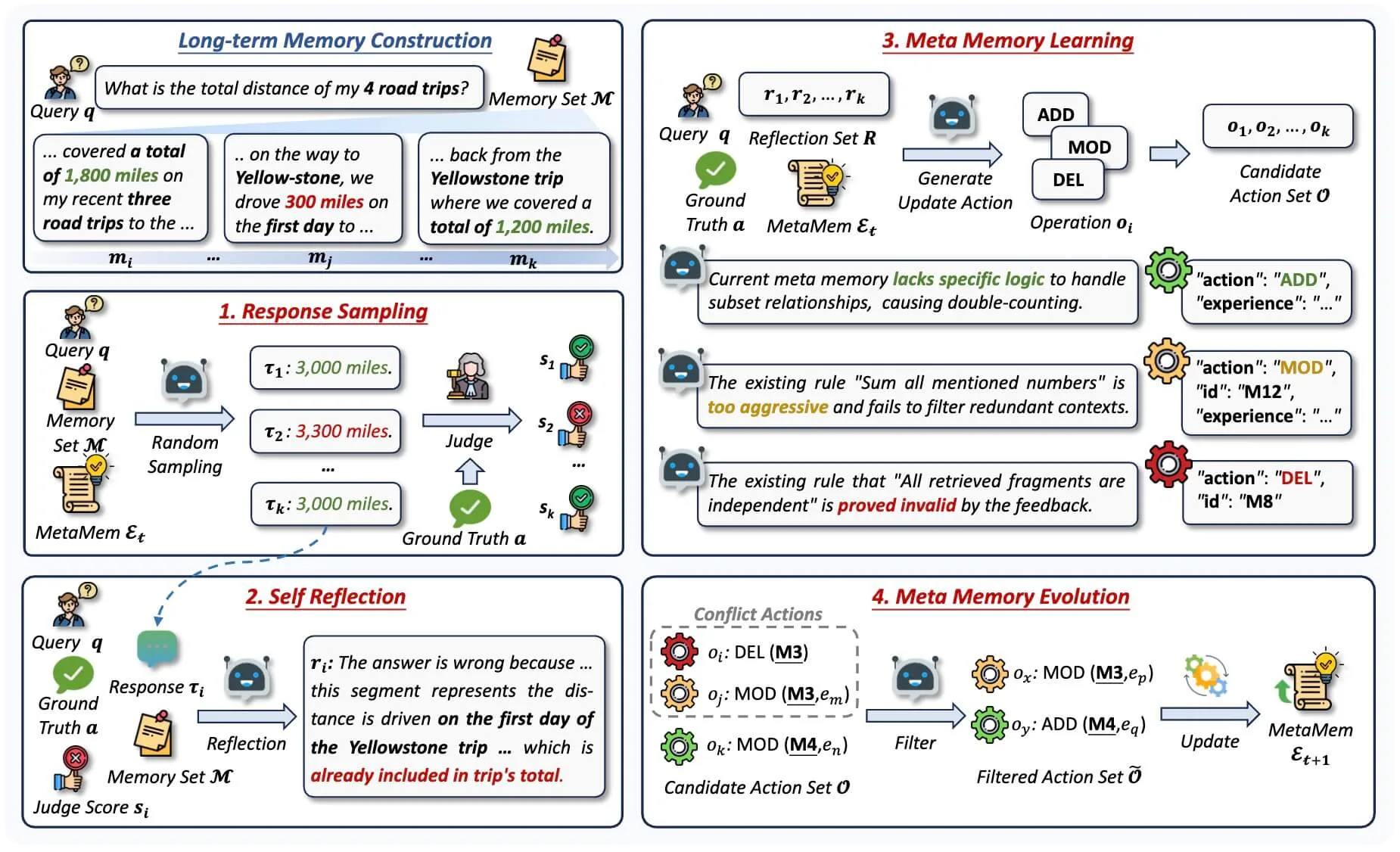

MetaMem: Evolving Meta-Memory for Knowledge Utilization through Self-Reflective Symbolic Optimization

Haidong Xin$^{*}$, Xinze Li$^{*}$, Zhenghao Liu$^†$, Yukun Yan$^†$, Shuo Wang, Cheng Yang, Yu Gu, Ge Yu, Maosong Sun

В этой работе предлагается MetaMem, фреймворк метапамяти, который развивает метапамять с помощью саморефлексивной символической оптимизации и тем самым улучшает использование знаний в долгосрочных взаимодействиях человека и LLM.

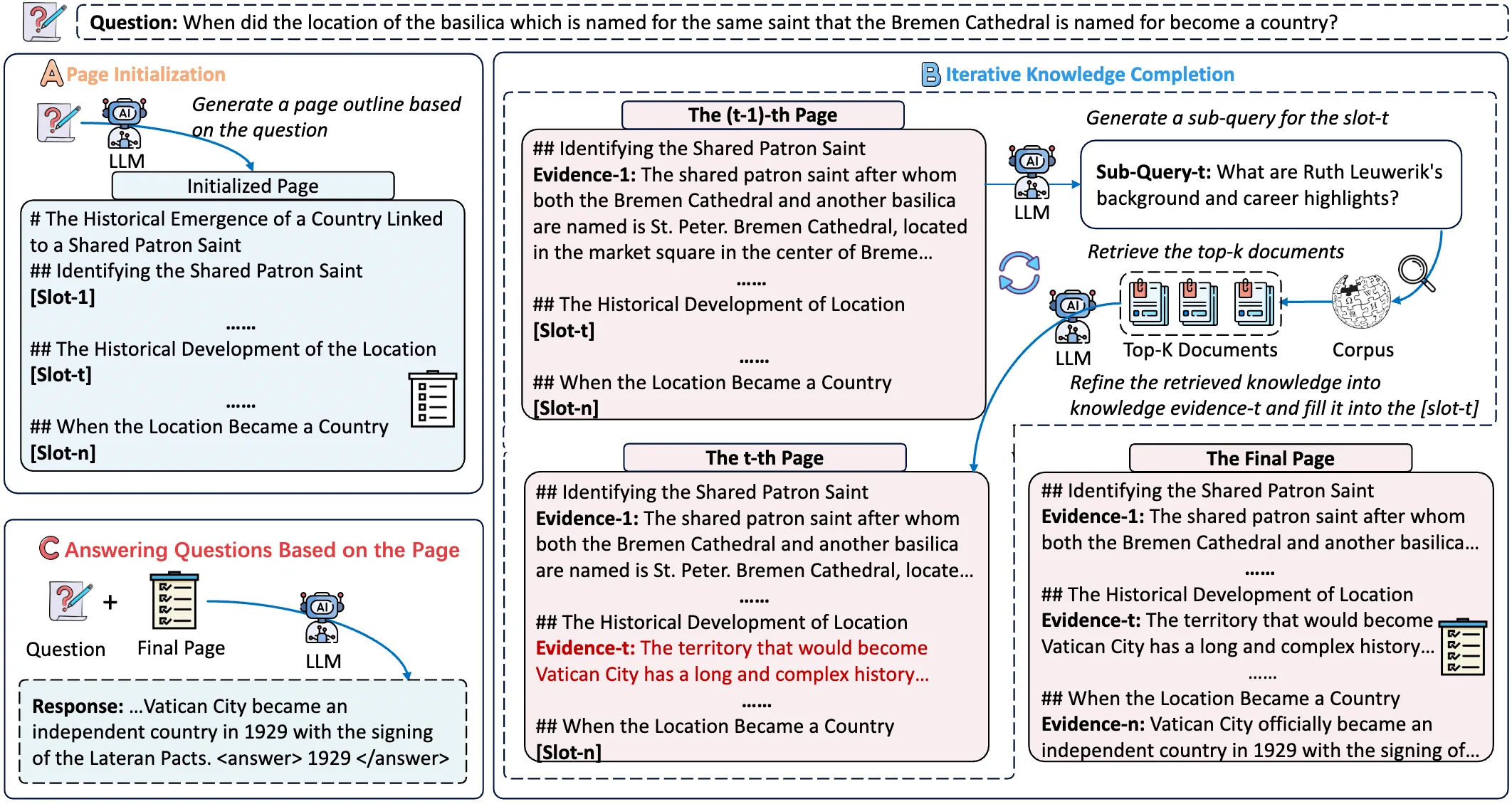

Structured Knowledge Representation through Contextual Pages for Retrieval-Augmented Generation

Xinze Li, Zhenghao Liu$^†$, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Zheni Zeng, Sen Mei, Ge Yu, Maosong Sun

Эта работа усиливает RAG-системы, создавая структурированные когнитивные планы для управления итеративным поиском и эффективно организуя многомерные знания в согласованные страницы для более точной генерации ответов.

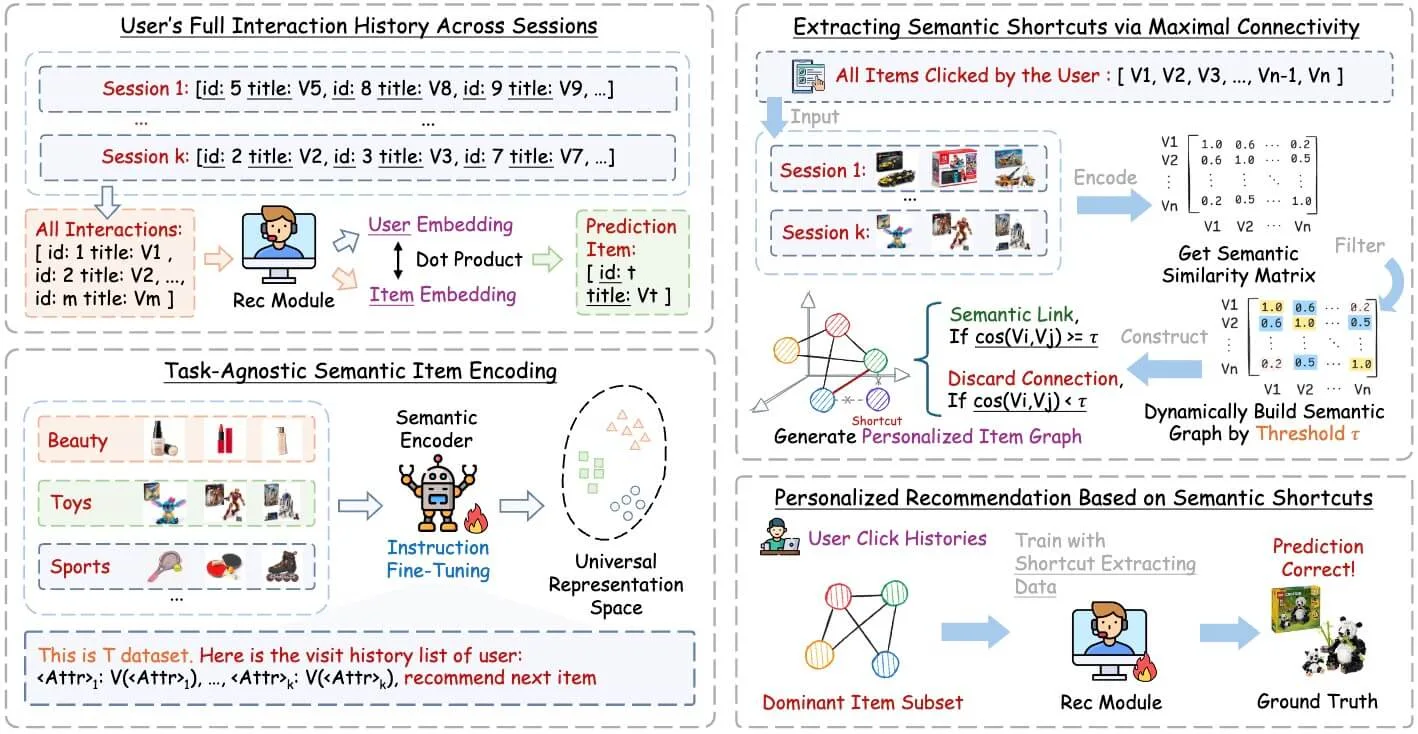

LISRec: Modeling User Preferences with Learned Item Shortcuts for Sequential Recommendation

Haidong Xin, Zhenghao Liu$^†$, Sen Mei, Yukun Yan, Shi Yu, Shuo Wang, Zulong Chen, Yu Gu, Ge Yu, Chenyan Xiong

Эта работа улучшает последовательные рекомендательные системы, извлекая персонализированные семантические сокращения из истории взаимодействий пользователя с объектами и лучше моделируя устойчивые предпочтения.

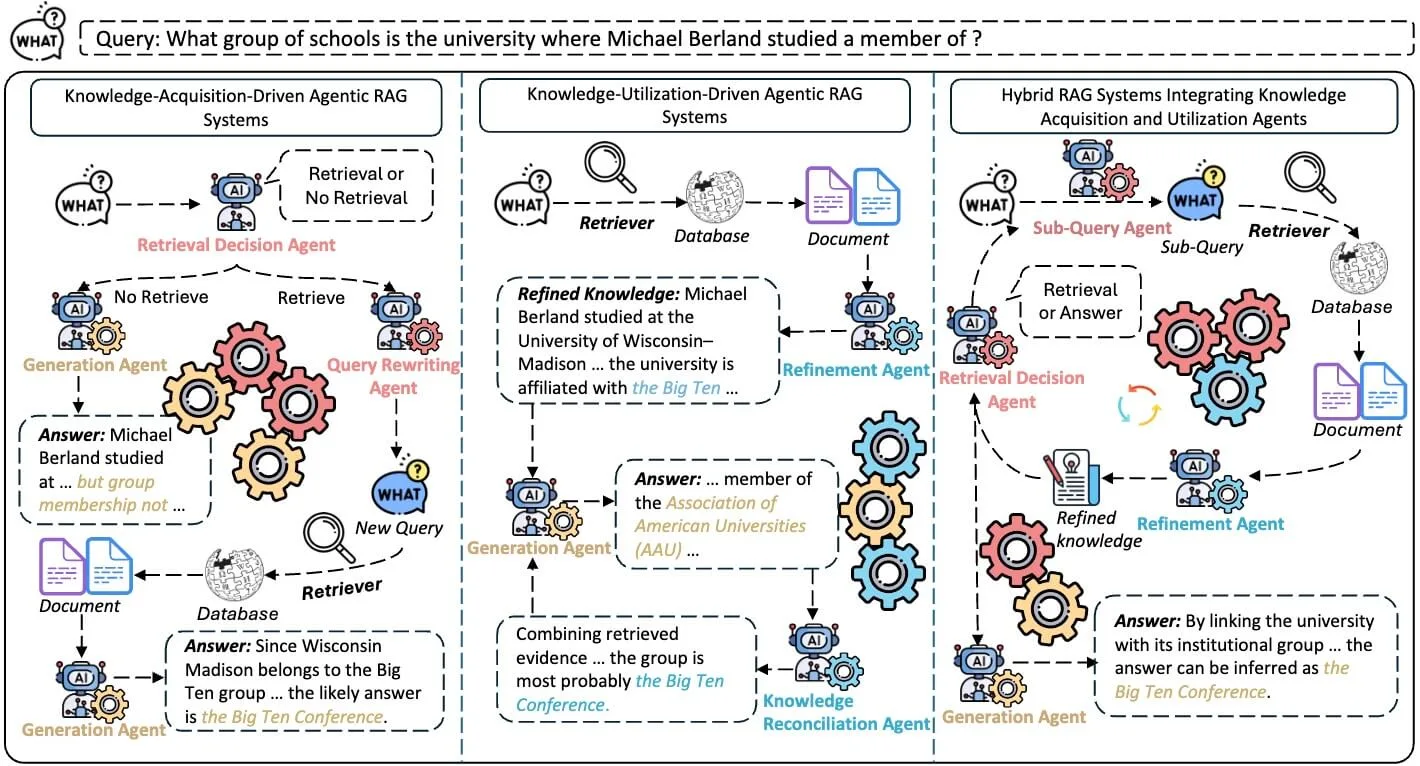

Knowledge Intensive Agents

Zhenghao Liu, Pengcheng Huang, Zhipeng Xu, Xinze Li, Shuliang Liu, Chunyi Peng, Haidong Xin, Yukun Yan$^†$, Shuo Wang, Xu Han, Zhiyuan Liu$^†$, Maosong Sun$^†$, Yu Gu, Ge Yu

Эта работа даёт всесторонний обзор Retrieval-Augmented Generation с агентной точки зрения, разделяя knowledge-intensive agents на роли приобретения и использования знаний и выделяя направления совместной оптимизации в multi-agent RAG-системах.

Adapting Language Models to Text Matching based Recommendation Systems

Haidong Xin, Sen Mei, Zhenghao Liu$^†$, Xiaohua Li, Minghe Yu, Yu Gu, Ge Yu

Эта работа значительно повышает качество текстового сопоставления в рекомендательных системах за счёт интеграции предварительного обучения языковых моделей.

LLMsPark: A Benchmark for Evaluating Large Language Models in Strategic Gaming Contexts

Junhao Chen, Jingbo Sun, Xiang Li, Haidong Xin, Yuhao Xue, Yibin Xu, Hao Zhao$^†$

Эта работа представляет LLMsPark, основанную на теории игр платформу для оценки стратегического поведения и способностей к принятию решений больших языковых моделей в мультиагентных средах.

MMAD: Multi-modal Movie Audio Description

Xiaojun Ye, Junhao Chen, Xiang Li, Haidong Xin, Chao Li, Sheng Zhou$^†$, Jiajun Bu

Эта работа открыла совершенно новый опыт просмотра фильмов для людей с нарушениями зрения.

Puzzle Game: Prediction and Classification of Wordle Solution Words

Haidong Xin$^{*†}$, Fang Wu$^{*}$, Zhitong Zhou$^{*}$

В этой работе был проведён подробный численный анализ игры Wordle, выявивший скрытые в ней статистические закономерности.

🏆 Награды

- 2025.11 🥇 Стипендия для выдающихся студентов, 1-я премия

- 2024.11 🥇 Стипендия для выдающихся студентов, 1-я премия

- 2023.07 🥈 Национальный 2-й приз в Chinese Collegiate Computing Competition (4C 2023)

- 2023.05 🥈 Honorable Mention на Mathematical Contest in Modeling (MCM/ICM 2023)

- 2023.05 🥈 2-я премия международного конкурса студенческих инноваций

- 2022.11 🥇 1-я премия в China Undergraduate Mathematical Contest in Modeling (CUMCM 2022)

- 2022.10 🥈 2-я премия лиги по математическому моделированию трёх северо-восточных провинций

- 2022.05 🥇 Стипендия для выдающихся студентов, 1-я премия

- 2021.05 🥇 Стипендия для выдающихся студентов, 1-я премия

📖 Образование

- 2024.09 - настоящее время, магистратура по компьютерным наукам, School of Computer Science and Engineering, Northeastern University

- 2020.09 - 2024.06, бакалавриат по компьютерным наукам, College of Computer Science and Technology, Harbin Engineering University

- 2017.09 - 2020.06, Yichun No.1 Middle School

💬 Упоминания в СМИ

- 2026.01, 【TsinghuaNLP】成果 | UltraRAG 3.0:拒绝“盲盒”开发,让每一行推理逻辑都清晰可见

- 2025.11, 【TsinghuaNLP】成果 | UltraRAG 2.1:强化知识接入与多模态支持,完善统一评估体系

- 2025.08, 【TsinghuaNLP】成果 | UltraRAG 2.0:几十行代码实现高性能 RAG,让科研专注思想创新

- 2025.01, 【喜报】一封来自哈尔滨工程大学写给伊春市第一中学的喜报

- 2024.06, 【一院一节】第三届“贡橙杯” CTF竞赛圆满落幕

- 2023.12, 【一院一节】第二届“贡橙杯” CTF竞赛圆满落幕

- 2023.07, 【一院一节】第一届“贡橙杯” CTF竞赛圆满落幕

- 2023.05, 【苏州同元软控信息技术有限公司】MoHub平台支持工科教学

💻 Исследования и стажировки

- 2024.04 - настоящее время, Qiyuan Lab (TsinghuaNLP), Пекин.

- 2024.10 - 2025.02, Language Technologies Institute (LTI), Carnegie Mellon University, дистанционно.

- 2023.10 - настоящее время, NEUIR Lab, Northeastern University, Шэньян.

- 2023.05 - 2023.06, China Unicom Research Centre, Харбин.

- 2023.07 - 2023.08, Workforce Development Program (WDP) of Oracle, Харбин.

- 2022.09 - 2024.06, E-Government Modeling Simulation National Engineering Laboratory, Харбин.